Con l’ultima generazione di telecamere di sicurezza ci si è convinti che chiunque, in qualsiasi momento, possa essere identificato attraverso intelligenza artificiale...

OFFERTA SPECIALE

OFFERTA SPECIALE

OFFERTA SPECIALE

Tutto il sito - Mese

6,99€ 1 € al mese x 12 mesi

Poi solo 4,99€ invece di 6,99€/mese

oppure

1€ al mese per 6 mesi

Tutto il sito - Anno

79,99€ 9,99 € per 1 anno

Poi solo 49,99€ invece di 79,99€/anno

In realtà però ci sono almeno due questioni che andrebbero considerate. La prima è che si tratta di un sistema imperfetto che, quindi, può commettere degli errori. Apple ad esempio, è stata appena citata in giudizio da uno studente universitario statunitense. Ousmane Bah, diciottenne residente nello stato di New York, è stato arrestato dalla polizia dopo che il servizio di sicurezza aveva associato grazie all’AI il suo volto a quello di un ladro che aveva sottratto tre iPhone da uno degli store del colosso di Cupertino. Uno scambio di persona che ha portato gli agenti della polizia a casa del giovane alle 4 del mattino per arrestarlo. Un fraintendimento che avrebbe causato grossi traumi emotivi allo studente che, per questo, ora prova a rivalersi sulla Apple.

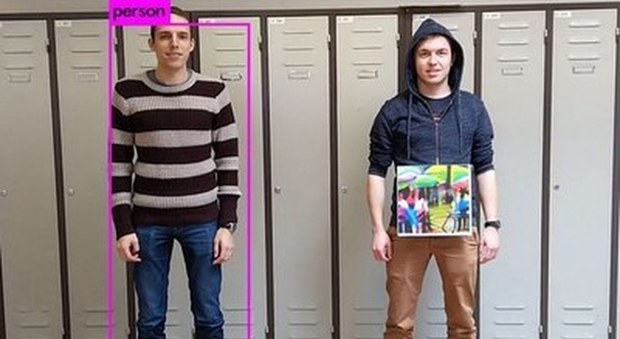

In secondo luogo, nel considerare gli strumenti di riconoscimento facciale come affidabili, vanno anche tenute in considerazione le possibili contromosse di chi non vuole essere riconosciuto. Al di là delle soluzioni fai-da-te come maschere (con cui però non è possibile girare indisturbati) o luci led posizionate attorno al volto (i fan della serie tv Luther, ne sanno qualcosa), esistono dei rimedi “professionali” che stanno facendo discutere. Un gruppo di ingegneri dell’Università di Leuven in Belgio ad esempio, con lo scopo dichiarato di limitare la capacità dei governi di rintracciare e identificare i cittadini in massa, hanno realizzato delle semplici immagini colorate che sono in grado di ingannare il riconoscimento facciale. In gergo tecnico si chiamano "esempi contraddittori" e semplicemente confondono l'intelligenza artificiale al punto da renderla inutile in termini di riconoscimento. Stampare una di esse e appenderla al collo infatti vale come indossare un mantello dell’invisibilità. Leggi l'articolo completo su

Il Messaggero